To brzmi jak spisek z Czarnego Lustra : studenci proszeni są o identyfikację pasujących obiektów, ale gdy robot dzwoni z oczywistą złą odpowiedzią, niektóre dzieci powtarzają dosłownie to, co bot mówi, zamiast korzystać z własnych mądrości. Ale to nie science fiction - nowe badanie opublikowane w Science Robotics sugeruje, że dzieci łatwo ulegają presji ze strony robotów.

Bill Andrews z Discover odkrył, że zespół niemieckich i brytyjskich naukowców zrekrutował 43 dzieci w wieku od 7 do 9 lat do wzięcia udziału w eksperymencie Ascha, teście zgodności społecznej udającym egzamin wzroku. Eksperyment, który został po raz pierwszy opracowany w latach 50. XX wieku, wymaga od uczestników porównania czterech linii i określenia dwóch pasujących długości. Istnieje oczywiście poprawna odpowiedź, ponieważ linie mają zazwyczaj bardzo różne długości, a kiedy dzieci były badane indywidualnie, odpowiadały na nie w 87 procentach przypadków.

Jednak po przybyciu robotów na scenę wyniki spadły do 75 procent.

„Kiedy dzieci były same w pokoju, były całkiem dobre w tym zadaniu, ale kiedy roboty brały udział i dawały błędne odpowiedzi, po prostu podążały za robotami”, współautor badania Tony Belpaeme, robot z University of Plymouth w Wielkiej Brytanii, mówi James Vincent z The Verge.

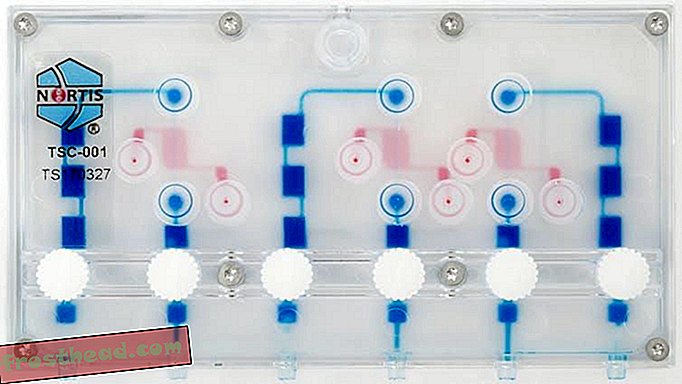

Na zdjęciu pokazano robota, konfigurację eksperymentu i „test wizyjny” pokazany uczestnikom (Vollmer i in.)

Na zdjęciu pokazano robota, konfigurację eksperymentu i „test wizyjny” pokazany uczestnikom (Vollmer i in.) W nowym środowisku testowym jeden ochotnik siedział jednocześnie z trzema humanoidalnymi robotami. Chociaż linie wymagające oceny pozostały wysoce rozróżnialne, uczestnicy dzieci wątpili w siebie i szukali wskazówek u swoich robotów. Spośród niepoprawnych odpowiedzi podanych przez dzieci 74 procent pasowało do tych dostarczonych przez słowo robot po słowie.

Alan Wagner, inżynier lotnictwa i kosmonauty z Pennsylvania State University, który nie był zaangażowany w nowe badania, mówi Carolyn Y. Johnson z Washington Post, że nieprzejednana wiara, którą ludzie często umieszczają w maszynach, jest znana jako „stronniczość automatyzacji”.

„Ludzie wierzą, że te maszyny wiedzą więcej niż oni, mają większą świadomość niż w rzeczywistości” - zauważa Wagner. „Nadają im wszystkie te niesamowite i fantazyjne właściwości”.

Vincent's Verge pisze, że badacze przeprowadzili ten sam test na grupie 60 osób dorosłych. W przeciwieństwie do dzieci, ci starsi uczestnicy utknęli w swoich odpowiedziach, odmawiając podążania (nieprawidłowymi) śladami robotów.

Wyobrażenie wyglądu robotów mogło mieć wpływ na brak wiary w dorosłych uczestników, wyjaśnia Belpaeme.

„[Oni] nie mają wystarczającej obecności, aby mieć wpływ” - mówi Vincent. „Są za małe, zbyt podobne”.

Uczestnicy przesłuchani na zakończenie egzaminu zweryfikowali teorię naukowców, stwierdzając, że zakładali, że roboty działają nieprawidłowo lub nie są wystarczająco zaawansowane, aby udzielić poprawnej odpowiedzi. Belpaeme zauważa, że możliwe jest, że gdyby badanie powtórzono przy użyciu bardziej autorytatywnych robotów, dorośli okazaliby się równie podatni jak dzieci.

Według komunikatu prasowego odkrycia zespołu mają daleko idące konsekwencje dla przyszłości branży robotyki. Ponieważ „autonomiczne roboty społeczne” stają się coraz bardziej powszechne w dziedzinie edukacji i poradnictwa dla dzieci, naukowcy ostrzegają, że należy podjąć środki ochronne w celu „zminimalizowania ryzyka dla dzieci podczas interakcji społecznych między robotami a dziećmi”.