Sztuczna inteligencja przeszła długą drogę od R2-D2. W dzisiejszych czasach większość pokoleń straciłaby bez inteligentnych systemów GPS. Roboty już nawigują na polach bitew, a drony mogą wkrótce dostarczać paczki Amazon na nasze drzwi.

Siri może rozwiązać skomplikowane równania i powiedzieć, jak gotować ryż. Udowodniła nawet, że potrafi odpowiedzieć na pytania z poczuciem humoru.

Ale wszystkie te postępy zależą od tego, czy użytkownik poda kierunek sztucznej inteligencji. Co by się stało, gdyby urządzenia GPS zdecydowały, że nie chcą chodzić do pralni chemicznej, albo, co gorsza, Siri zdecydowała, że mogłaby stać się mądrzejsza bez ciebie?

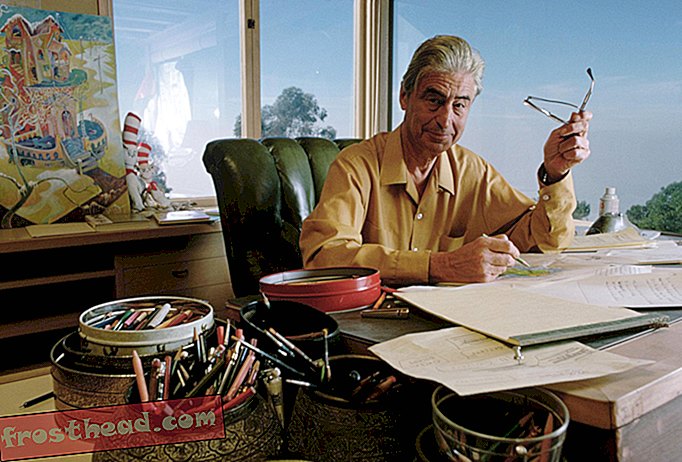

Nasz ostateczny wynalazek: sztuczna inteligencja i koniec ludzkiej ery. "> Nasz ostateczny wynalazek: sztuczna inteligencja i koniec ludzkiej ery. ”>„ Zanim podzielimy planetę z superinteligentnymi maszynami, musimy opracować naukę, aby je zrozumieć. W przeciwnym razie przejmie kontrolę ”, mówi autor James Barrat o swojej nowej książce, Our Final Invention: Artificial Intelligence and the End of the Human Era . (Dzięki uprzejmości Jamesa Barrata)

Nasz ostateczny wynalazek: sztuczna inteligencja i koniec ludzkiej ery. ”>„ Zanim podzielimy planetę z superinteligentnymi maszynami, musimy opracować naukę, aby je zrozumieć. W przeciwnym razie przejmie kontrolę ”, mówi autor James Barrat o swojej nowej książce, Our Final Invention: Artificial Intelligence and the End of the Human Era . (Dzięki uprzejmości Jamesa Barrata) To tylko oswojone wyniki James Barrat, autor i autor filmów dokumentalnych, prognozuje w swojej nowej książce Our Final Invention: Artificial Intelligence and the End of the Human Era .

Barrat mówi, że niedługo sztuczna inteligencja - od Siri po drony i systemy eksploracji danych - przestanie szukać ludzi do ulepszeń i sama zacznie szukać ulepszeń. I w przeciwieństwie do R2-D2 i HAL science fiction, sztuczna inteligencja naszej przyszłości niekoniecznie będzie przyjazna, mówi: mogą być tym, co nas zniszczy.

W skrócie, czy możesz wyjaśnić swój wielki pomysł?

W tym wieku naukowcy będą tworzyć maszyny o inteligencji równej, a następnie przewyższającej naszą. Ale zanim podzielimy planetę z superinteligentnymi maszynami, musimy opracować naukę, aby je zrozumieć. W przeciwnym razie przejmą kontrolę. I nie, to nie jest science fiction.

Naukowcy już stworzyli w szachach maszyny lepsze niż ludzie, Jeopardy!, nawigacja, eksploracja danych, wyszukiwanie, dowodzenie twierdzeń i niezliczone inne zadania. W końcu zostaną stworzone maszyny lepsze od ludzi w badaniach nad AI

W tym momencie będą mogli bardzo szybko poprawić swoje możliwości. Te samodoskonalące się maszyny będą realizować cele, z którymi zostały stworzone, niezależnie od tego, czy będą to eksploracja kosmosu, gra w szachy czy zbieranie akcji. Aby odnieść sukces, będą poszukiwać i wydatkować zasoby, czy to energię, czy pieniądze. Będą starali się unikać trybów awarii, takich jak wyłączenie lub odłączenie od zasilania. Krótko mówiąc, opracują dyski, w tym samoobronę i pozyskiwanie zasobów - dyski podobne do naszych. Nie wahają się błagać, pożyczać, kraść i gorzej, aby zdobyć to, czego potrzebują.

Jak zainteresowałeś się tym tematem?

Jestem filmowcem dokumentalnym. W 2000 r. Przeprowadziłem wywiad z wynalazcą Rayem Kurzweilem, robotem Rodneyem Brooksem i legendą science-fiction Arthurem C. Clarke dla filmu TLC o tworzeniu powieści i filmu 2001: A Space Odyssey. Wywiady badały ideę Hal 9000 i wrogich komputerów. Książki Kurzweila przedstawiają przyszłość AI jako porywającą „osobliwość”, okres, w którym postęp technologiczny przewyższa zdolność ludzi do ich rozumienia. A jednak spodziewał się, że po sztucznej inteligencji pojawią się tylko dobre rzeczy, które są wystarczająco silne, aby je dopasować, a następnie przewyższyć ludzką inteligencję. Przewiduje, że będziemy mogli przeprogramować komórki naszego ciała, aby pokonać choroby i starzenie się. Rozwiniemy super wytrzymałość dzięki nanobotom, które dostarczają więcej tlenu niż czerwone krwinki. Uzupełnimy nasz mózg implantami komputerowymi, abyśmy stali się superinteligentni. Przeniesiemy nasze mózgi na bardziej trwały nośnik niż nasze obecne „wetware” i będziemy żyć wiecznie, jeśli będziemy chcieli. Brooks był optymistą, twierdząc, że roboty z AI będą sojusznikami, a nie zagrożeniami.

Z drugiej strony Clarke, który został naukowcem, był pesymistą. Powiedział mi, że inteligencja wygra, a ludzie prawdopodobnie będą rywalizować o przetrwanie z superinteligentnymi maszynami. Nie sprecyzował, co się stanie, gdy będziemy dzielić planetę z superinteligentnymi maszynami, ale czuł, że dla ludzkości nie byłoby wygranej.

Było to sprzeczne ze wszystkim, co myślałem o sztucznej inteligencji, więc zacząłem przeprowadzać wywiady z ekspertami od sztucznej inteligencji.

Jakie masz dowody na poparcie swojego pomysłu?

Zaawansowana sztuczna inteligencja jest technologią podwójnego zastosowania, taką jak rozszczepienie jądra atomowego, zdolną do wyrządzenia wielkich korzyści lub szkód. Właśnie zaczynamy dostrzegać krzywdę.

Skandal związany z prywatnością NSA powstał, ponieważ NSA opracowała bardzo zaawansowane narzędzia do eksploracji danych. Agencja wykorzystała swoją moc, aby zebrać metadane milionów połączeń telefonicznych i cały Internet - co najważniejsze, wszystkie wiadomości e-mail. Uwiedziona przez sztuczną inteligencję eksploracji danych agencja, której powierzono ochronę Konstytucji, nadużyła jej. Opracowali narzędzia, które są zbyt potężne, aby można było z nich odpowiedzialnie korzystać.

Dzisiaj rozpoczyna się kolejna etyczna bitwa o stworzenie w pełni autonomicznych zabójczych dronów i robotów bojowych zasilanych przez zaawansowaną AI - zabójców ludzi bez ludzi w pętli. Powstaje między Departamentem Obrony a twórcami dronów i robotów opłacanymi przez DOD, a ludźmi, którzy uważają, że tworzenie inteligentnych maszyn do zabijania jest głupotą i niemoralnością. Zwolennicy autonomicznych dronów i robotów bojowych twierdzą, że będą bardziej moralni - to znaczy mniej emocjonalni, będą celować lepiej i będą bardziej zdyscyplinowani niż operatorzy. Ci, którzy nie chcą wyciągać ludzi z pętli, patrzą na nieszczęśliwą historię zabijania cywilów przez drony i udział w pozasądowych zamachach. Kto przejmuje moralną winę, gdy robot zabija? Twórcy robotów, użytkownicy robotów czy nikt? Nie przejmuj się technicznymi przeszkodami w odróżnianiu przyjaciela od wroga.

W dłuższej perspektywie, jak twierdzą eksperci z mojej książki , sztuczna inteligencja zbliżająca się do inteligencji na poziomie ludzkim nie będzie łatwo kontrolować; niestety, super-inteligencja nie oznacza dobroci. Jak to ujął teoretyk AI Eliezer Yudkowsky z MIRI [Instytutu Badań Inteligencji Maszyn]: „AI nie kocha cię ani nie nienawidzi cię, ale jesteś zbudowany z atomów, które mogą wykorzystać do czegoś innego.” Jeśli etyka nie może wbudowani w maszynę, będziemy tworzyć superinteligentnych psychopatów, stworzenia bez moralnych kompasów, i nie będziemy ich panami na długo.

Co nowego w twoim myśleniu?

Osoby i grupy tak różnorodne, jak amerykański informatyk Bill Joy i MIRI od dawna ostrzegają, że musimy się bardzo bać maszyn, których inteligencja przyćmiewa naszą. W naszym ostatecznym wynalazku twierdzę, że sztuczna inteligencja będzie również niewłaściwie wykorzystywana na ścieżce rozwoju inteligencji na poziomie ludzkim. Od dnia dzisiejszego do dnia, w którym naukowcy będą tworzyć inteligencję na poziomie ludzkim, będziemy mieć błędy związane z AI i aplikacje przestępcze.

Dlaczego nie zrobiono więcej lub co zrobiono, aby powstrzymać AI przed zwróceniem się przeciwko nam?

Nie ma jednego powodu, ale wielu. Niektórzy eksperci nie sądzą, że jesteśmy wystarczająco blisko do stworzenia sztucznej inteligencji na poziomie ludzkim i nie tylko, aby martwić się ryzykiem. Wielu twórców AI wygrywa kontrakty z Agencją Zaawansowanych Projektów Badawczych Obrony [DARPA] i nie chce podnosić kwestii, które uważają za polityczne. Normalne nastawienie jest nastawieniem poznawczym, który uniemożliwia ludziom reagowanie na katastrofy i katastrofy w trakcie ich tworzenia - to zdecydowanie część tego. Ale wielu twórców AI coś robi. Sprawdź naukowców, którzy doradzają MIRI. I o wiele więcej zostanie zaangażowanych, gdy niebezpieczeństwa związane z zaawansowaną AI wejdą w główny nurt dialogu.

Czy możesz opisać moment, w którym wiedziałeś, że to duże wydarzenie?

My, ludzie, kierujemy przyszłością nie dlatego, że jesteśmy najszybszymi lub najsilniejszymi stworzeniami na planecie, ale dlatego, że jesteśmy najmądrzejsi. Kiedy dzielimy planetę z istotami mądrzejszymi od nas samych, będą one kierować przyszłością. Kiedy zrozumiałem ten pomysł, poczułem, że piszę o najważniejszym pytaniu naszych czasów.

Każdy wielki myśliciel ma swoich poprzedników, których praca była kluczowa dla jego odkrycia. Kto dał ci podstawę do zbudowania Twojego pomysłu?

Podstawy analizy ryzyka AI opracował matematyk IJ Good, pisarz science fiction Vernor Vinge i inni, w tym twórca AI Steve Omohundro. Dziś MIRI i Oxford's Future of Humanity Institute są prawie same w rozwiązaniu tego problemu. Nasz końcowy wynalazek zawiera około 30 stron przypisów końcowych potwierdzających tych myślicieli.

Jaki był punkt kulminacyjny w badaniu i rozwijaniu Twojego pomysłu? A niski punkt?

Punktem kulminacyjnym było pisanie „ Ostatecznego wynalazku” i mój ciągły dialog z twórcami sztucznej inteligencji i teoretykami. Ludzie, którzy programują AI, zdają sobie sprawę z problemów związanych z bezpieczeństwem i chcą pomóc w opracowaniu zabezpieczeń. Na przykład MIRI pracuje nad stworzeniem „przyjaznej” sztucznej inteligencji

Informatyk i teoretyk Steve Omohundro opowiadał się za podejściem „rusztowania”, w którym sztucznie bezpieczna sztuczna inteligencja pomaga zbudować sztuczną inteligencję nowej generacji, aby zapewnić jej bezpieczeństwo. To AI robi to samo i tak dalej. Myślę, że należy stworzyć partnerstwo publiczno-prywatne, aby zgromadzić twórców sztucznej inteligencji i dzielić się pomysłami na temat bezpieczeństwa - coś w rodzaju Międzynarodowej Agencji Energii Atomowej, ale we współpracy z korporacjami. Niskie punkty? Zdając sobie sprawę, że do tworzenia broni zostanie wykorzystana najlepsza, najbardziej zaawansowana technologia AI. I ta broń ostatecznie zwróci się przeciwko nam.

Jakie dwie lub trzy osoby najprawdopodobniej spróbują obalić twój argument? Czemu?

Wynalazca Ray Kurzweil jest głównym apologetą ds. Zaawansowanych technologii. W moich dwóch wywiadach z nim twierdził, że łączymy się z technologiami sztucznej inteligencji poprzez ulepszenia poznawcze. Kurzweil i ludzie powszechnie nazywani transhumanistami i osobnikami uważającymi AI i ostatecznie sztuczna inteligencja ogólna i nie tylko będą ewoluować wraz z nami. Na przykład implanty komputerowe zwiększą szybkość naszego mózgu i ogólne możliwości. W końcu opracujemy technologię przenoszenia naszej inteligencji i świadomości do komputerów. Wówczas super-inteligencja będzie przynajmniej częściowo ludzka, co teoretycznie zapewni, że super-inteligencja będzie „bezpieczna”.

Z wielu powodów nie jestem fanem tego punktu widzenia. Kłopot w tym, że my, ludzie, nie jesteśmy niezawodnie bezpieczni i wydaje się mało prawdopodobne, by superinteligentni ludzie też byli. Nie mamy pojęcia, co stanie się z etyką człowieka po wzmocnieniu jego inteligencji. Mamy biologiczną podstawę agresji, której brakuje maszynom. Super wywiad może równie dobrze być multiplikatorem agresji.

Na kogo ten pomysł najbardziej wpłynie?

Wszyscy na tej planecie mają wiele powodów do obaw przed nieuregulowanym rozwojem superinteligentnych maszyn. Obecnie trwa wyścig wywiadu. Osiągnięcie AGI jest numerem jeden dla Google, IBM i wielu mniejszych firm, takich jak Vicarious i Deep Thought, a także DARPA, NSA oraz rządy i firmy za granicą. Zysk jest główną motywacją tego wyścigu. Wyobraź sobie jeden prawdopodobny cel: wirtualny ludzki mózg za cenę komputera. Byłby to najbardziej intratny towar w historii. Wyobraź sobie banki tysięcy mózgów doktorantów pracujących 24 godziny na dobę przez 7 dni w tygodniu nad rozwojem farmaceutyków, badań nad rakiem, rozwojem broni i wiele innych. Kto nie chciałby kupić tej technologii?

Tymczasem 56 narodów opracowuje roboty na polu bitwy, a ich celem jest uczynienie ich i dronów autonomicznymi. Będą to maszyny, które zabijają, bez nadzoru ludzi. Zubożałe narody najbardziej ucierpią z powodu autonomicznych dronów i robotów na polu bitwy. Początkowo tylko bogate kraje będą mogły pozwolić sobie na autonomiczne roboty zabijające, więc bogate narody będą miały tę broń przeciwko ludzkim żołnierzom zubożałych narodów.

Jak może zmienić życie, jakie znamy?

Wyobraź sobie: w ciągu zaledwie dekady pół tuzina firm i narodów produkuje komputery, które rywalizują lub przewyższają ludzką inteligencję. Wyobraź sobie, co się stanie, gdy komputery te staną się ekspertami w programowaniu inteligentnych komputerów. Wkrótce będziemy dzielić planetę z maszynami tysiące lub miliony razy bardziej inteligentnymi niż my. Przez cały czas każda generacja tej technologii będzie uzbrojona. Nieuregulowany, będzie katastrofalny.

Na jakie pytania nie ma odpowiedzi?

Rozwiązania. Oczywistym rozwiązaniem byłoby nadanie maszynom moralnego sensu, który sprawia, że cenią ludzkie życie i własność. Ale programowanie etyki w maszynę okazuje się niezwykle trudne. Normy moralne różnią się w zależności od kultury, zmieniają się z czasem i są kontekstowe. Jeśli my, ludzie, nie możemy się zgodzić, kiedy zaczyna się życie, to jak możemy powiedzieć maszynie, która ma ją chronić? Czy naprawdę chcemy być bezpieczni , czy naprawdę chcemy być wolni ? Możemy dyskutować o tym przez cały dzień i nie osiągać konsensusu, więc jak możemy to zaprogramować?

My także, jak wspomniałem wcześniej, musimy zgromadzić programistów AI. W latach siedemdziesiątych badacze rekombinowanego DNA postanowili zawiesić badania i spotkać się na konferencji w Asilomar w Pacific Grove w Kalifornii. Opracowali podstawowe protokoły bezpieczeństwa, takie jak „nie wyśledzić DNA na butach” z obawy przed skażeniem środowiska w toku prac genetycznych. Ze względu na „Wytyczne Asilomar” świat czerpie korzyści z genetycznie zmodyfikowanych upraw, a terapia genowa wygląda obiecująco. O ile wiemy, unikano wypadków. Czas na konferencję Asilomar dla AI

Co stoi na przeszkodzie?

Ogromny wiatr gospodarczy napędza rozwój zaawansowanej inteligencji na poziomie ludzkim za cenę komputera będzie najgorętszym towarem w historii. Google i IBM nie będą chciały udostępniać swoich tajemnic opinii publicznej ani konkurencji. Departament Obrony nie będzie chciał otwierać swoich laboratoriów dla Chin i Izraela i odwrotnie. Świadomość publiczna musi popychać politykę w kierunku otwartości i partnerstw publiczno-prywatnych mających na celu zapewnienie bezpieczeństwa.

Co dalej dla ciebie

Jestem filmowcem dokumentalnym, więc oczywiście myślę o filmowej wersji Naszej ostatecznej wynalazki .